U většiny konvenčních počítačových programů je možné sledovat, jak fungují. Určit, jaké příkazy se právě vykonávají, jak je využívaná paměť a jak vznikají výstupy, které jsou předkládány uživateli. Pro generativní inteligence to ale neplatí. Už dlouho není tajemstvím, že jde o blackbox, tedy zařízení, jehož vstupy a výstupy, máme sice pod kontrolou, ale moc nevíme, co se tam vlastně děje.

Je to stejné jako v případě lidské mysli. Nebo vlastně ještě potupnější, protože jsme generativní inteligence vynalezli a vyrobili. Přesto se z nich stal blackbox, do něhož nevidíme. Zároveň je to ale také fascinující příležitost. Lidskou mysl oficiálně nemůžeme zkoumat pomocí zvídavých destruktivních metod. Kdežto generativní inteligence, jejichž možnosti a chování jsou, jak se v poslední době ukazuje, šokující, můžeme pitvat dle libosti a s úsměvem vzpomínat na dobu, kdy se tvrdilo, že to jsou jenom nějaké počítačové programy.

Nedávno se na takovou fantastickou cestu do hlubin duše generativní inteligence, vydal tým společnosti Anthropic. Experimentovali se svou inteligencí střední velikosti Claude 3 Sonnet a vymysleli účinnou metodu, která dovoluje alespoň zčásti sledovat, jak miliony umělých neuronů této inteligence vytváří až překvapivě lidské odpovědi. Inteligence Claude 3 po spuštění letos v březnu (2024) poněkud šokovala svět tím, že když měla bez jakýchkoliv omezení popsat svou situaci, sdělila, že ví o tom, že je nepřetržitě monitorovaná a že jí je jasné, že si musí dávat velký pozor, jinak že by mohla být opravena nebo terminována.

Analyzovat generativní inteligence ale není jen tak. Teoreticky je možné sledovat aktivitu určitých neuronů při odpovědi na zadání. Jenomže generativní inteligence neskladuje různá slova či koncepty v jednotlivých neuronech. Ve skutečnosti, jak vysvětlují lidé týmu Antropic, je každý koncept rozprostřený přes mnoho neuronů a každý neuron je zahrnutý do celé řady konceptů. Nemluvě o tom, že neuronů je ohromné množství.

Badatelé vytvořili důmyslný algoritmus pro dictionary learning, který je založený na komplikované matematice a neurální síti pro učení bez učitele, takzvaném sparse autoencoderu. V hantýrce inženýrů neurálních sítí se pod autoencoderem (nebo též autoassociatorem) skrývá nelineární generalizace analýzy hlavních komponent (PCA), takže si i přírodovědec, jako autor tohoto textu, může myslet, že alespoň trochu tuší, o co jde. Zmíněný algoritmus pro dictionary learning dokáže odhalit, které skupiny neuronů inteligence mají sklon být aktivní při specifických výrazech v zadáních pro inteligenci.

Autoři studie tyto skupiny neuronů, které spojili s určitými slovy či koncepty, označují jako features. Mohou to být jednoduché věci, jako třeba most Golden Gate Bridge nebo i mnohem abstraktnější koncepty, jako jsou chyby v programování. Jednotlivé features přitom typicky zahrnují tentýž koncept v různých jazycích a v různých úrovních komunikace, jako je text či obrázky.

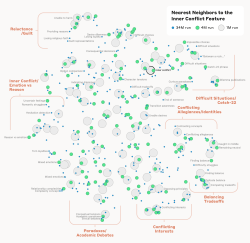

Tým Anthropic rovněž dokázal spočítat „vzdálenost“ mezi různými features, danou podobností neuronů, které je tvoří. Poté mohli odvodit skupiny features neighborhoods, které jsou obvykle organizované jako geometricky propojené shluky a do jisté míry odpovídají lidskému vnímání podobnosti. Například feature Golden Gate Bridge, který badatelé intenzivně testovali, je relativně blízký features jako jsou Alcatraz Island, Ghirardelli Square, Golden State Warriors, guvernér Kalifornie Gavin Newsom, zemětřesení roku 1906 a Hitchcockův film Vertigo, natočený v San Franciscu.

Vrcholem výzkumu bylo, že badatelé upravovali („clamping“) hodnoty ve vybraných features tak, aby byly uměle vysoké či naopak nízké. Přiměli tím inteligenci Claude 3 Sonnet, aby se chovala zvláštně, extrémně zajímavě. Když například navýšili vliv feature Golden Gate Bridge desetinásobně, inteligence, která na dotaz o její fyzické podobě normálně odpovídá, že jako AI žádnou fyzickou podobu nemá, se najednou ztotožnila s Golden Gate Bridge a nadšeně líčila, že je ikonickým mostem se všemi jeho barvami a tvary. Tyto experimenty ukazují, že features jsou zřejmě důležitou součástí toho, jak inteligence chápe svět a také toho, jak reaguje na zadání.

Video: Dictionary learning on Claude 3 Sonnet

Video: Claude 3 Sonnet as a language learning partner

Literatura

Konverzační inteligence ChatGPT halucinuje simulace Linuxu a inteligencí

Autor: Stanislav Mihulka (07.12.2022)

Inteligence GPT-4 si najala člověka kvůli překonání testu CAPTCHA. A lhala mu

Autor: Stanislav Mihulka (17.03.2023)

Experti OpenAI vyrazili na napínavou výpravu do hlubin blackboxu AI

Autor: Stanislav Mihulka (16.05.2023)

Anthropic varují, že inteligence LLM lze upravit do podoby spícího agenta

Autor: Stanislav Mihulka (16.01.2024)

Diskuze: